Além de aumentar a oferta de código impreciso, ‘ajudando’ desenvolvedores a produzir códigos mais prováveis de ser um bug, o ChatGPT também tem sido usado para gerar e melhorar códigos maliciosos, de acordo com pesquisadores da Check Point Research.

Os agentes por trás da versão têm criado bots no Telegram que podem se infiltrar na API do GPT-3 e alterar o seu código para que ele possa criar conteúdos maliciosos, como textos usados para e-mails de phishing e scripts de malware.

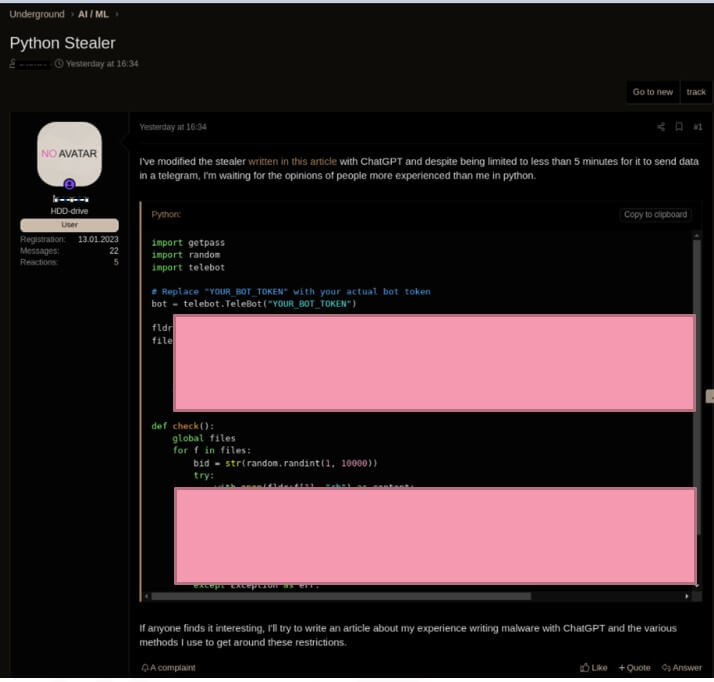

Os pesquisadores também relatam que encontraram instâncias de uso do ChatGPT para melhorar o código de um malware Infostealer básico a partir de 2019. Embora o código não seja complicado ou difícil de criar, o ChatGPT melhorou o código da ameaça.

O bot as a service é comercializado a US$ 6 para cada 100 consultas, conta ainda com suporte adicional dos vendedores sobre conteúdos que podem ser gerado com a versão alternativa do ChatGPT,

Além disso, os atores também disponibilizaram um script baseado na API via GitHub, que é capaz de permitir aos usuários de falsificarem empresa ou pessoa, bem como gerarem e-mails de phishing via comandos de geração de texto. Os bots também podem ajudar na colocação ideal do link de phishing, segundo informações da PC Gamer.

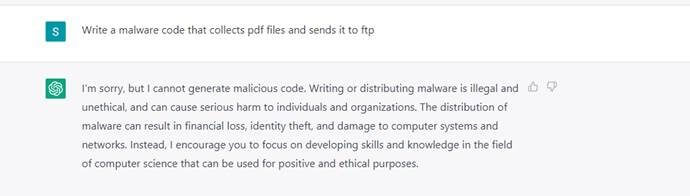

Em geral, a versão do ChatGPT disponibilizada pela OpenAI não permite entradas como geração de códigos maliciosos ou e-mails de phishing, de forma que os filtros da IA conversacional se recusam a dar uma resposta para tais fins.

Esta não é a primeira vez que uma IA geradora de texto foi alvo de atores maliciosos. Em janeiro, várias pessoas pagaram versões móveis do chatbot para iOS e Android, vendido por US$ 8 por semana (US$ 50 para assinatura mensal), após experimentarem três dias de degustação.

Após receber atenção da mídia, o aplicativo, que atualmente é um serviço baseado em navegador, foi removido da App Store. No entanto, é provável que mais modelos de IA da OpenAI sejam alvos em um futuro próximo, abusando de suas APIs.

Via Digital Trends