A visão computacional é o algoritmo que faz um computador identificar os objetos em uma imagem, por exemplo, diferenciar um carro de uma bicicleta. Para treinar computadores com inteligência artificial com essa capacidade, é necessário nomear uma grande quantidade de imagens e muitas horas de trabalho. Isso agora muda com um novo algoritmo do MIT.

Pesquisadores do MIT CSAIL em colaboração com a Universidade de Cornell e a Microsoft desenvolveram o STEGO (Self-supervised Transformer with Energy-based Graph Optimization). Recentemente divulgado, o algoritmo de visão computacional consegue identificar cada pixel de uma imagem, o que torna a visão computacional mais rápida e mais fácil.

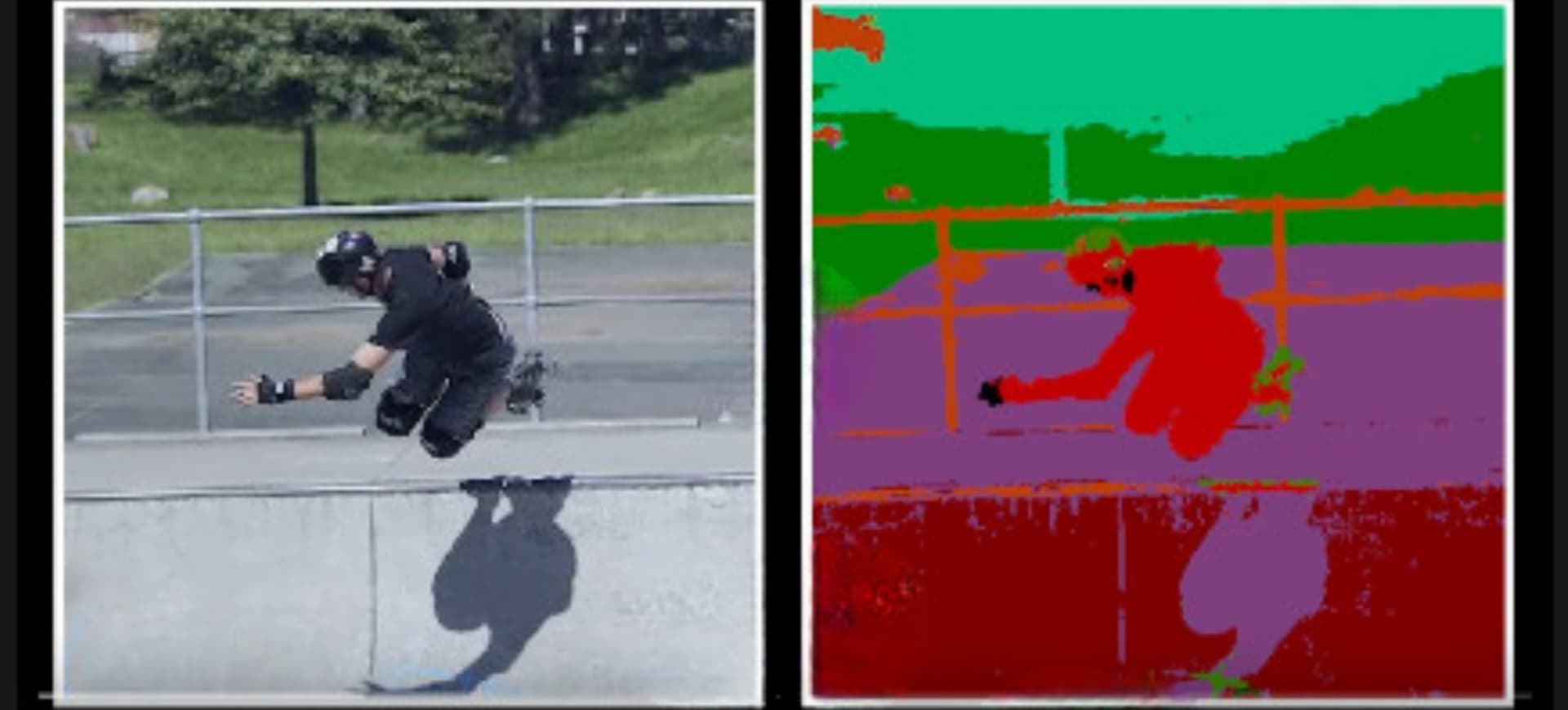

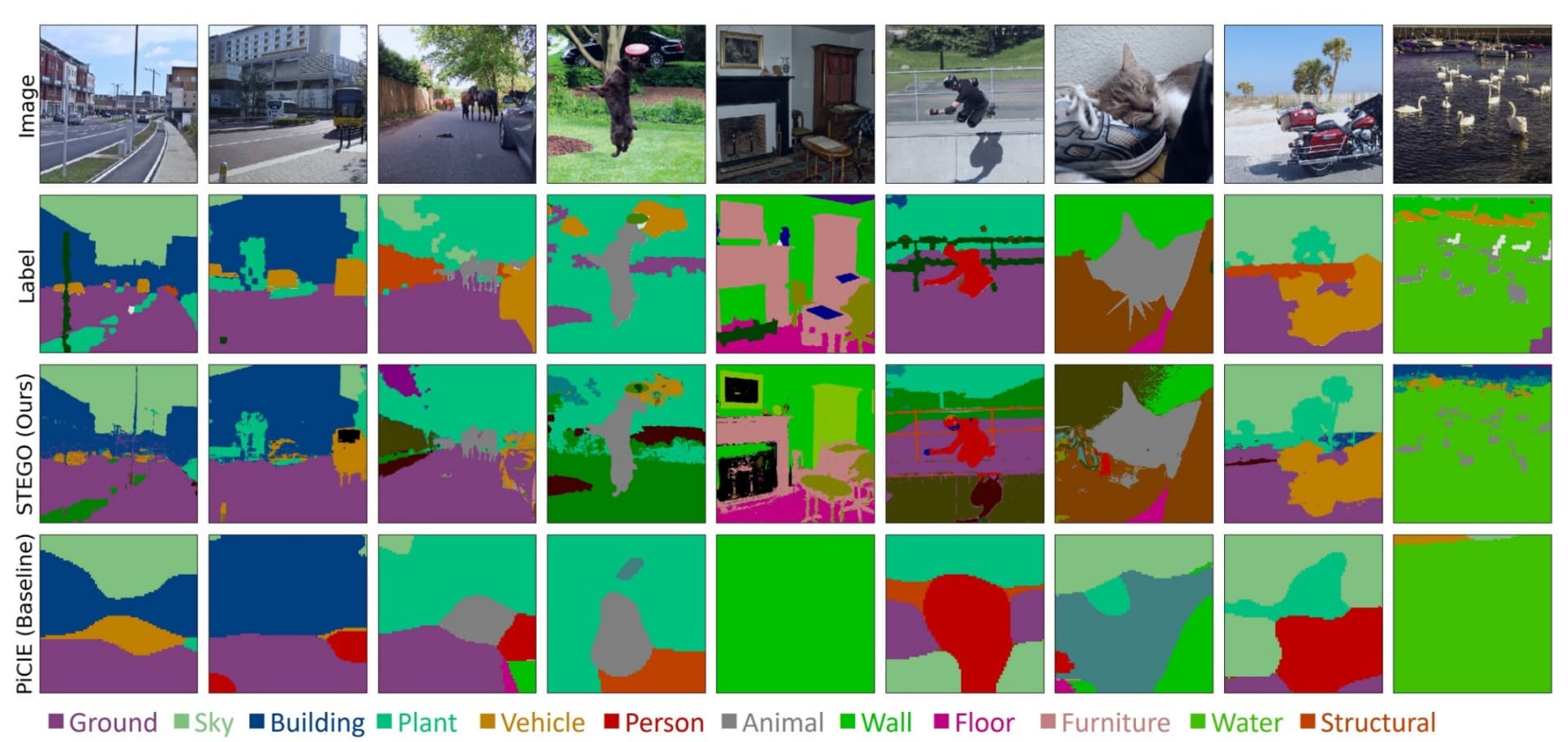

A técnica utilizada no STEGO é chamada de segmentação semântica, que aplica um nome a um conjunto de pixels semelhantes na imagem para dar à inteligência artificial uma visão mais exata do cenário.

Ainda que o número de pixels em uma imagem possa ser de milhões, o algoritmo reduz o trabalho identificando objetos similares em um conjunto de dados visuais. “Assim, a associação de objetos similares ajuda a construir uma visão do mundo consistente a partir de várias imagens de treinamento”, afirmaram os pesquisadores.

Em alguns cenários, o visão computacional pode ver melhor que humanos

“Quando olhamos para scans oncológicos, a superfície de planetas ou imagens de alta resolução, é difícil saber quais objetos identificar sem o conhecimento específico. Em domínios emergentes, mesmo humanos especialistas não conseguem ver quais são os objetos relevantes”, afirma o doutorando no MIT e engenheiro de software da Microsoft Mark Hamilton. “Nessas situações, em que se quer desenhar um método para novas fronteiras na ciência, é melhor confiar primeiro no olhar de máquinas do que de humanos”.

STEGO foi testado em vários tipos de cenários, desde fotografias aéreas a cenários que um motorista veria. Em cada grupo de imagens, o algoritmo conseguiu identificar e classificar objetos relevantes e aproximar-se do julgamento humano. Em um de seus melhores resultados do algoritmo, com um grupo de imagens bastante diverso, o algoritmo surpreendeu nos detalhes. Antes, humanos eram vistos como uma bolha, uma moto era confundida com uma pessoa e gansos não eram reconhecidos. A pesquisa indicou que todos foram reconhecidos além de animais, prédios, móveis e outros objetos.

A descoberta foi registrada em um artigo por Hamilton, o doutorando do MIT CSAIL Zhoutong Zhang, o professor assistente Bharath Hariharan da Universidade de Cornell, o professor associado Noah Snavely da Cornell Tech, e o professor do MIT William T. Freeman. O artigo será apresentado na International Conference on Learning Representations (ICLR) 2022.