Microsoft pretende aposentar ferramenta que consegue identificar emoções

A decisão da Microsoft foi apoiada pela ideia de que a controversa ferramenta não considera algumas questões que diferem as populaçõesBy - Luiz Nogueira, 22 junho 2022 às 9:18

Atualmente, a Microsoft conta com diversas ferramentas para reconhecimento facial usando inteligência artificial (IA). No entanto, em um esforço para eliminar essa prática, a empresa está gradualmente retirando o acesso público a essas funcionalidades.

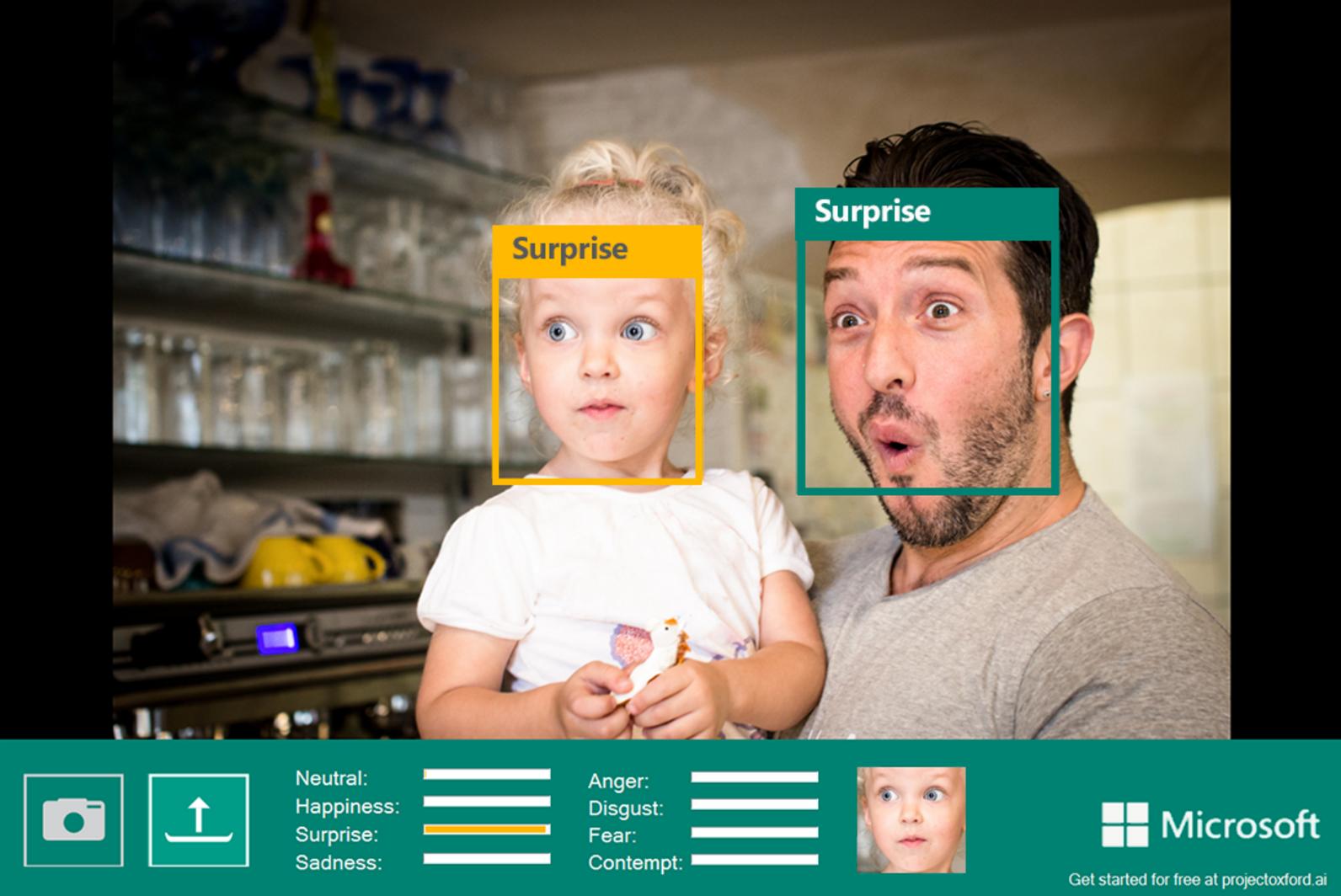

A principal delas, uma ferramenta que promete detectar emoções a partir de fotos e vídeos, foi bastante criticada por especialistas. Isso porque muitos afirmam que não é correto igualar demonstrações externas de emoção com sentimentos internos.

Além disso, foi citado que, por conta de diferenças de população para população, os resultados poderiam diferir, causando situações adversas.

A decisão pela eliminação dessas ferramentas faz parte de uma grande revisão da Microsoft acerca de suas políticas de ética de IA. Atualmente, seus padrões estão voltados para a responsabilidade de descobrir quem usa seus serviços.

Com a nova decisão, a Microsoft quer limitar o acesso a alguns recursos de reconhecimento facial, como os presentes no Azure Face. Em casos mais extremos, eles serão removidos completamente. No caso de sistemas em que há o desfoque automático de rostos, o acesso continuará aberto.

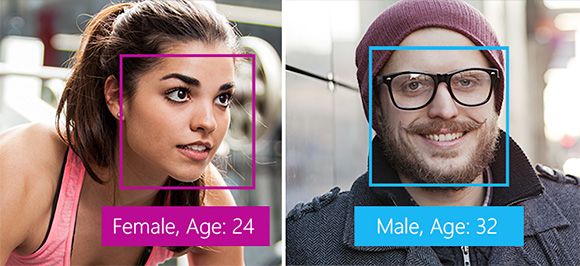

Mas além de remover o acesso do público às ferramentas do Azure Face, a Microsoft vai impedir que o software detecte atributos diversos, como sexo, idade, sorriso, barba, cabelo e maquiagem.

Imagem: Divulgação

A eliminação dessas ferramentas começou a acontecer na última terça-feira (21), embora os clientes que utilizam a funcionalidade perderão seus acessos em 30 de junho de 2023.

“Especialistas dentro e fora da empresa destacaram a falta de consenso científico sobre a definição de ‘emoções’, os desafios de como as interferências se generalizam em casos de uso, regiões e dados demográficos”, descreveu Natasha Crampton, diretora de IA da Microsoft, ao falar sobre os motivos pelos quais tomaram essa decisão.

Mas além do reconhecimento de emoções, a Microsoft vai implementar restrições a um recurso chamado Custom Neural Voice, que permite o uso de IA para criar vozes com base em gravações de pessoas reais.

Isso tem um grande potencial educativo, embora também possa ser usado para recriar vozes de forma inadequada e enganar pessoas.

Uso interno da Microsoft

Imagem: Microsoft

Mesmo com a decisão de retirar o acesso do público, a Microsoft vai continuar usando a ferramenta para uma função necessária. O aplicativo Seeing AI vai manter o acesso, já que ele é utilizado para descrever o mundo para pessoas com deficiência visual.

Via: The Verge

Comentários