IA: autorregulamentação não é suficiente para controlar danos, adverte especialista

Sugestões à regulamentação focaram em cuidado com o cidadão, impactos sobre direitos humanos e papel cooperativo e controlador do Estado nesta tarefaBy - Liliane Nakagawa, 13 junho 2022 às 18:35

Prorrogada por mais 120 dias, a comissão de juristas responsável por elaborar uma proposta de regulamentação de inteligência artificial no Brasil promoveu nesta quinta (9) e sexta-feira (10) um seminário internacional, ouvindo posicionamentos de especialistas da tecnologia acerca dos fundamentos e desafios de uma regulamentação e a relação com a proteção de dados e técnicas regulatórias baseadas em risco.

Eles destacaram que o caminho para regulamentação da tecnologia deve permear questões de proteção dos cidadãos e dos seus respectivos dados, além de dar atenção a um sistema de responsabilização e impactos que a tecnologia pode exercer em direitos humanos e individuais. O papel do Estado como agente controlador e cooperativo da IA também é necessário na definição do arcabouço legal sobre o tema.

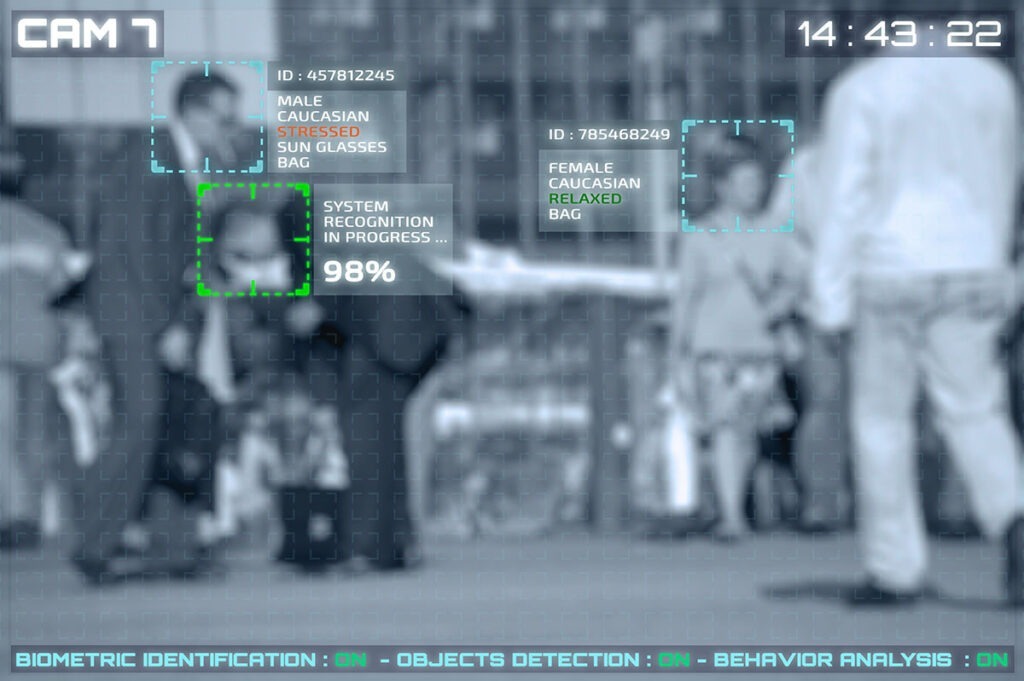

Imagem: Den Rise/Shutterstock.com

O professor de direito e inovação na Bucerius Law School, em Hamburgo, Wolfgang Hoffmann-Riem, disse que para criar uma legislação que toque todas as dimensões sobre o tema, de forma segura, é preciso trabalhar com harmonia e transparência. Além disso, detalha o professor, que ela não oriente somente em riscos, mas que se preocupe com a proteção de dados e dos cidadãos.

Para Hoffmann-Riem, a autorregulamentação não é suficiente para controlar danos. “Os sistemas de inteligência artificial não podem ultrapassar os direitos dos cidadãos. (…) O Estado tem de trabalhar no controle e na cooperação com o sistema de inteligência artificial”, posiciona ele.

Imagem: pixinoo/Shutterstock.com

A regulamentação do sistema de responsabilização foi destacada na fala da professora e pesquisadora na Vrije Universiteit Brussels (VUB) Mireille Hildebrandt, que também detalhou sistemas de alto risco. “Temos de ter um sistema de gestão de risco, para garantir que não haja nenhum direito individual violado. Com documentação técnica detalhada e uma regulamentação do mercado”, afirmou Hildebrandt.

Impactos da IA sobre os direitos humanos e individuais, propósitos e reais beneficiários da tecnologia foram questões levantadas no discurso da advogada e diretora-executiva da Derechos Digitales (DD), Maria Paz Canales, que ecoou a participação ativa do governo. “É inalienável a obrigação que o Estado tem para a regulamentação desses sistemas. Precisamos observar uma proposta [de lei] que abranja todo os elementos que concretizem os princípios fundamentais. (…) As escolhas envolvidas na IA não podem ser tomadas sem um exercício aberto com o público”, disse.

Imagem: Geraldo Magela/Agência Senado

Ao finalizar o painel, o professor na Universidade da Califórnia Stuart Russell ressaltou que o algoritmo nunca pode superar os direitos humanos, posicionamento defendido pelos demais palestrantes do dia, lembrando que o mais fundamental deles é o direito à vida.

IA: experiências de outras nações

Os “Desafios da regulação de Inteligência Artificial: experiências comparadas” foi tema do segundo painel, realizado ainda na quinta-feira (9), no qual os especialistas trouxeram experiências de regulamentação europeia e os riscos associados.

Imagem: Roque de Sá/Agência Senado

Irina Orssich, chefe da Caneles Política Setorial de IA da Comissão Europeia, disse que a UE implementou a primeiras estratégia para as regras de regulamentação da tecnologia em abril de 2018. Segundo ela, foram definidos com quatro estados-membros contribuições para o ecossistema da tecnologia, e que em abril do ano passado foi apresentado um pacote de IA.

Com o Parlamento Europeu, a Comissão e o Conselho elaboraram um texto final para regulamentação e espera que até o fim do ano ele seja aprovado. “Queremos harmonizar as regras e as leis e, com essa abordagem de segurança, abordamos os temas de IA que estão no mercado, de forma que todos tenham de cumprir com as mesmas regras. (…) Estamos fazendo uma abordagem baseada em risco. Não queremos regular toda a tecnologia. É um ato horizontal, aplica-se igualmente a todos os setores”, disse.

Já a diretora do Centro de Pesquisas em Proteção de Dados na Universidade de Frankfurt, Indra Spiecker, chama atenção aos efeitos colaterais da inteligência artificial, exigindo controle além de colocar, de fato, a regulamentação em vigor. “De modo geral, o que precisamos é que tudo seja mais especifico para que possamos controlar o desenvolvimento da tecnologia”, afirmou Spiecker.

O professor e chefe de departamento no Instituto Universitário Europeu (EUI), Hans Wolfgang Micklitz, também salientou preocupações, mas desta vez focado no consumidor brasileiro, diferentemente do que ocorre na legislação europeia. “Aqueles que estão usando a tecnologia não devem influenciar o consumidor”, disse Micklitz.

IA: proteção de dados e técnicas regulatórias baseadas em risco

Na sexta-feira (10), ao retomar o seminário internacional, os especialistas na área analisaram temas relacionados à proteção de dados e técnicas regulatórias baseadas em risco.

Gabriela Zanfir, representante do Future of Privacy Forum nos Estados Unidos, frisou que qualquer que seja o estágio do processamento automatizado de dados pessoais, esse deve priorizar a raça humana como forma de proteger seus respectivos direitos. “A meta da proteção de dados é garantir que a informação relacionada ao indivíduo seja coletada e utilizada a partir de meios automatizados e algorítmicos de tal forma que todos os seus demais direitos fundamentais sejam protegidos. Precisamos proteger esses dados pessoais. Mesmo que decisões automatizadas atuem em larga escala, é preciso assegurar que essas decisões sejam tomadas de forma justa. Que as liberdades pessoais sejam protegidas, como o direito a privacidade, segurança, não discriminação e liberdade de reunião”, explicou.

Já o professor da Universidade Politécnica de Turim, na Itália, Alessandro Mantelero, destacou a fala sobre uma abordagem de proteção de dados baseada em riscos, advertindo sobre os cuidados em sobrepor o interesse econômico aos direitos individuais em casos de coleta e processamento de informações pessoais.

“A avaliação de risco significa que você precisa avaliar o risco antes que ele ocorra. É preciso desenvolver uma inteligência artificial que seja orientada e motivada pelos direitos humanos. O interesse meramente econômico não pode prevalecer sobre a proteção de dados pessoais. É um tipo de hierarquia entre os interesses. Não quer dizer que você não pode fazer negócios ou não pode ter proteção de interesses econômicos. Mas o foco deve ser os direitos humanos”, argumentou Mantelero.

Na sequência, os especialistas trouxeram sugestões ao painel de questões sobre técnicas regulatórias e abordagem baseada em risco. Sobre o assunto, Eike Graf, representante da Comissão Europeia, defendeu aplicar a legislação de direitos fundamentais à gestão de dados por IA.

“Se já existem algumas regras, devemos trazer adendos a elas. Regras trabalhistas e leis do consumidor são relevantes para a utilização em sistemas de inteligência artificial. O uso de um sistema de IA está sujeito a direitos e obrigações. Se houver algum problema na utilização de tecnologias, deve-se evitar a prática, se necessário. Os direitos que temos para proteger os direitos fundamentais obviamente continuam a ser aplicados em diversas outras instâncias. A questão é onde devemos, devido à opacidade ou à complexidade, fazer um esforço extra para manter os direitos que já estão dispostos, assim como propor deveres extras”, sugeriu Graf.

Por outro lado, Pam Dixon, fundadora do World Privacy Forum, defendeu um sistema regulatório específico para dar conta desse cenário de aceleração em temas como inteligência artificial e machine learning.

“O mundo diante de nós é outro, totalmente diferente de dez anos atrás. Ao pensarmos sobre regulações para esses sistemas, pensamos que são sistemas visíveis para nós. Porém, cada vez mais estamos indo em direção a um mundo em que eles não serão apenas invisíveis. Eles serão como os encanamentos das casas: você sabe que está lá porque você consegue ligar a torneira. Mas você não vai necessariamente conseguir ver os canos. Estamos seguindo rapidamente para isso. Quando isso acontecer, será necessário um controle regulatório distinto”, disse.

A Comissão temporária formada por 18 especialistas terá até agosto para sugerir uma minuta de substitutivo reunindo os três PLs em tramitação sobre o assunto (5.051/2019, 21/2020 e 872/2021), no qual estabelecem princípios, regras, diretrizes e fundamentos para regular o desenvolvimento e a aplicação da inteligência artificial no Brasil.

Com informações de Senado Federal e Convergência Digital

Comentários