Quais são os limites técnicos – e éticos – da Inteligência Artificial?

Falta de maturidade sobre o tema não pode justificar a demora em se debater publicamente um marco legal e ético para as ações de Inteligência Artificial. É preciso impor os limites antes que tudo saia do controleBy - Alessandra Montini, 21 junho 2022 às 18:30

Recentemente, pesquisadores do Google afirmaram que estão próximos de desenvolver uma inteligência artificial similar ao nível humano e totalmente diferente do que já foi visto até agora no universo da tecnologia. Foi o suficiente para destravar um antigo debate que sempre permeou os estudos sobre robótica e digitalização. Se é possível construir robôs tão ou até mais inteligentes do que homens, quais são os limites para esse desenvolvimento?

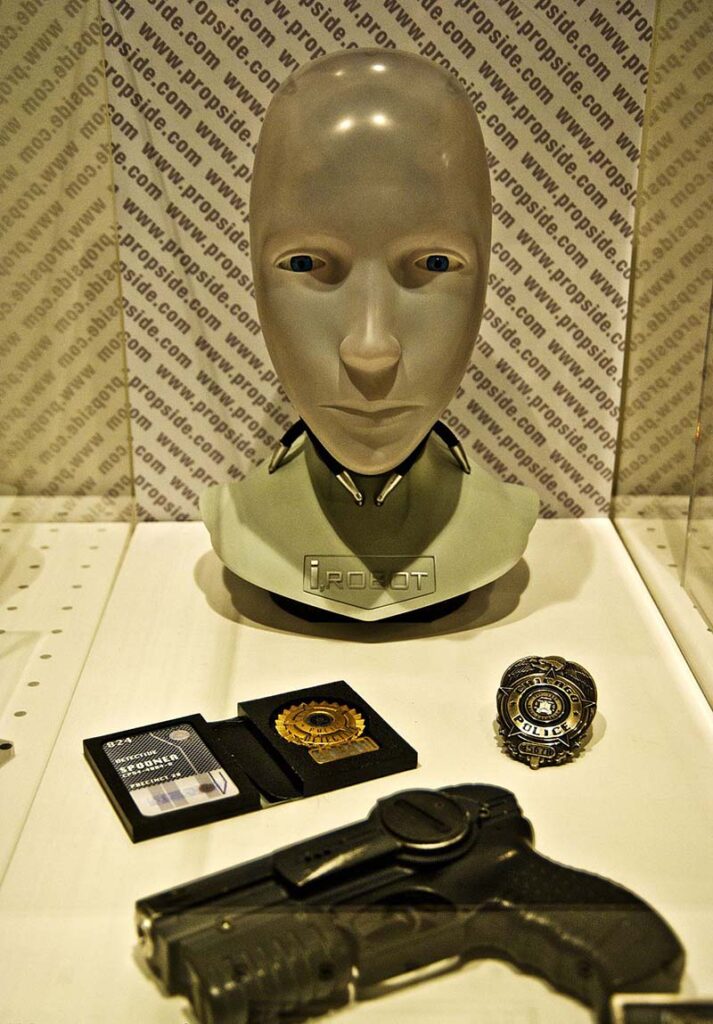

Imaginar máquinas conscientes que se rebelam contra os seres humanos é matéria-prima para diversos clássicos de ficção científica. Isaac Asimov, um dos mais famosos escritores desse gênero, chegou a propor a criação de “três leis da robótica”, que propõe que um robô não pode infligir nenhum mal a um ser humano, deve sempre obedecer às ordens dadas e proteger sua própria existência, desde que uma regra não viole a outra. Entretanto, o que há muito tempo parecia inimaginável, começa a ganhar forma com a digitalização.

Imagem: reprodução/Boston Dynamics

Hoje, os robôs já existem e executam diversas funções nos mais diferentes setores da sociedade. Se eles não possuem a figura humanóide que costumamos ver em filmes e desenhos animados, é preciso reconhecer que muitos desempenham um papel crucial para a transformação digital que estamos experimentando atualmente. Essas soluções permitiram que as pessoas pudessem expandir o conhecimento e realizarem novas tarefas e atividades.

A questão é que essas máquinas não possuíam consciência. Mas e se os pesquisadores do Google estiverem certos e num futuro próximo a Inteligência Artificial atingir o mesmo nível dos humanos? Elas poderiam desenvolver uma capacidade cognitiva própria e, portanto, desenvolver pensamentos sem intervenção dos homens?

Imagem: Andres Urena/Unsplash

Mesmo que isso esteja fora de cogitação e seja um cenário distópico, o simples fato dos pesquisadores e profissionais de tecnologia quebrarem barreiras em IA servem para chamar atenção ao que realmente importa. É preciso debater limites éticos e entender os desafios técnicos que existem em relação às tecnologias de Inteligência Artificial. Como toda ferramenta, elas podem trazer muitos benefícios, mas também vários danos para as pessoas. Com regras, é possível direcioná-las para a promoção da vida humana.

A ética e a Inteligência Artificial

Nesse texto, vamos compreender como ética, os valores e princípios morais que regem a ação humana na vida em sociedade. Em outras palavras: são as regras que permitem que as pessoas convivam de forma harmoniosa, usufruindo de seus direitos e realizando seus deveres. O leitor mais atento já compreendeu o paradoxo. A ética diz respeito aos homens e mulheres. Mas qual seria sua atuação para as ações derivadas de máquinas com Inteligência Artificial?

É nesse ponto que se debruçam as principais discussões legais em torno da IA e robótica – e para qual é necessário encontrar alternativas o quanto antes, uma vez que a evolução tecnológica não para. A UNESCO, por exemplo, já determinou algumas diretrizes importantes. A entidade lembra que são os seres humanos os responsáveis pela criação, planejamento e desenvolvimento de todas as etapas de funcionamento da Inteligência Artificial. Logo, existe a possibilidade de estabelecer parâmetros éticos para impedir um futuro distópico.

Imagem: Urko Dorronsoro from Donostia – San Sebastian, Euskal Herria (Basque Country), CC BY-SA 2.0 <https://creativecommons.org/licenses/by-sa/2.0>, via Wikimedia Commons

O único ponto de discórdia, como não poderia deixar de ser, é em relação à culpabilidade diante de acidentes, danos e prejuízos causados por robôs. Quem vai responder cível e criminalmente? As empresas, os profissionais que operam as máquinas ou quem deveria fiscalizar? Nos Estados Unidos, um acidente com um veículo autônomo da Uber em fase de testes matou uma pedestre atropelada – e a justiça estadunidense teve que descascar esse abacaxi nas várias etapas do julgamento.

O Modelo S Tesla após cena do acidente perto de Williston, na Florida. National Transportation Safety Board, Public domain, via Wikimedia Commons

É uma faca de dois gumes. Quanto mais demora para determinar e resolver essas pendências, mais riscos as autoridades e órgãos competentes correm. A falta de maturidade sobre o tema é um empecilho, sem dúvida, mas não pode justificar a demora em se debater publicamente um marco legal e ético para as ações de Inteligência Artificial. É preciso impor os limites antes que tudo saia do controle.

E quais são os desafios técnicos?

Está claro que o surgimento de robôs superinteligentes, com consciência própria e com emoções ainda ficará restrito ao universo da ficção científica. Mas será que dá para chegar a esse cenário, ainda que a longo prazo? Sabemos que a tecnologia evolui de forma cada vez mais rápida com a consolidação das soluções digitais. O fato é que até nisso vai chegar em um limite que não poderá ser ultrapassado.

Os próprios pesquisadores do Google citados no primeiro parágrafo deste texto chegaram a afirmar que esse nível de inteligência artificial seria uma espécie de “game over”. Ou seja, seria um avanço tão significativo que acabaria com a ideia atual que temos de desenvolvimento de tecnologia como o conhecemos. Seria uma espécie de nova fase – e evidentemente com novas regras em jogo.

É claro que o avanço tecnológico depende, primeiramente, da criatividade humana – e essa realmente parece não ter limites. Mas o desenvolvimento de novas soluções e ferramentas precisa acompanhar o conhecimento teórico e prático. Há situações que não podem ocorrer porque simplesmente não há estrutura suficiente para isso! É por isso que muitas inovações demoram décadas para que, de fato, possam ocorrer.

Hoje, por exemplo, debate-se bastante a questão do Metaverso e de suas inúmeras possibilidades. Entretanto, essa capacidade de interagir por meio de avatares em ambientes digitais imersivos ainda vai levar vários anos até se tornar algo prático no dia a dia. Com a IA vai ser a mesma coisa. Além dos limites éticos servirem como uma barreira, muitas das propostas ficarão engavetadas pela falta de recursos.

É preciso debater a Inteligência Artificial

Em todo o caso, fica evidente a importância de autoridades, empresas e entidades da sociedade civil aprofundarem o debate público em torno da Inteligência Artificial. O que vivenciamos nos últimos dois anos de pandemia de covid-19 em termos de tecnologia não tem precedentes na história da humanidade.

Novos hábitos surgiram rapidamente e se consolidaram, extinguindo velhos comportamentos pelo mundo. Quanto mais cedo nos estruturarmos e colocarmos esses limites necessários, menores os riscos para a vida em sociedade e mais segurança teremos para aproveitarmos as vantagens e benefícios que essa ferramenta pode – e deve – oferecer a todos!

—

Comentários